안녕하세요,

OpenAI가 GPT-5를 공식 출시한 이후 업계와 사용자들 사이에서 다양한 반응이 이어지고 있습니다. 일부에서는 이전 세대 모델보다 확실히 향상되었다는 긍정적인 평가를 내리고 있으며, 다른 한편에서는 기대에 미치지 못했다는 아쉬움의 목소리도 나오고 있습니다. 이처럼 엇갈린 의견이 공존하는 가운데, 출시 후 2주가 지난 현재 시점에서 LLM 성능에 어떤 변화가 나타났는지 살펴보겠습니다.

이번 포스팅에는 두 가지 주요 지표를 활용합니다.

- 실사용자 투표 기반 순위(Chatbot Arena)는 실제 사용자가 직접 모델을 사용한 뒤 투표로 평가한 결과로, 실제 체감 성능과 사용자 만족도를 반영합니다.

- 종합 벤치마크 점수(Artificial Analysis)는 다양한 표준 테스트셋을 활용해 모델의 추론 능력, 창의성, 멀티모달 이해력 등을 점수화하여 객관적인 성능을 측정합니다.

이 두 지표(벤치마크 성능과 실사용자 선호도)를 함께 살펴보며, 현재 시장에서 주목할 만한 모델과 그 특징을 비교 정리하고, 이어지는 본문에서 2025년 8월 최신 순위표와 모델별 장단점에 대해 살펴보겠습니다.

[참고 링크]

- 실사용자 투표 기반 (LMArena) : https://lmarena.ai/leaderboard

- 종합 벤치마크 점수 (Artificial Analysis) : https://artificialanalysis.ai/

AI 모델 선택 가이드 (전체 요약)

| 구분 | 추천 모델 |

| 최고의 성능 | GPT-5 (high) |

| 웹 개발·코딩 특화 | GPT-5 (high), Claude Opus 4.1 |

| 가성비 최우수 | gpt-oss-20B |

| 강력한 오픈소스 | gpt-oss-120B, Qwen3-235B (Reasoning) |

| 한국어 최적화 | EXAONE-4.0-32B |

LMArena - Text·WebDev 카테고리 TOP 모델 비교

LMArena에서는 LLM(대형 언어 모델)을 다양한 카테고리별로 나누어 평가합니다.

아래 표는 2025년 8월 기준 Text와 WebDev 카테고리의 상위권 모델 순위를 보여주며, 각 AI 모델의 전반적인 성능과 특정 과제에서의 경쟁력을 한눈에 확인할 수 있습니다.

[ Text 모델 성적 ]

Text 카테고리는 LLM의 전반적인 언어 이해력, 추론 능력, 문맥 유지 능력을 종합적으로 평가하는 영역입니다.

이 순위는 대화 품질, 질문·답변 정확도, 창의적인 문장 생성 능력 등을 기준으로 산출되며, 모델이 다양한 주제와 상황에서 얼마나 일관되고 유용한 답변을 제공하는지를 보여줍니다.

2025년 8월 21일 기준 순위 (Chatbot Arena)

- Gemini-2.5-pro — 점수 1457 (31,991표)

- GPT-5-high — 점수 1455 (9,162표)

- Claude Opus 4.1 thinking-16k — 점수 1451 (6,440표)

- o3 (2025-04-16) — 점수 1445 (37,814표)

- ChatGPT-4o (20250326) — 점수 1442 (34,489표)

[ WebDev 모델 성적 ]

WebDev 카테고리는 웹 개발 관련 작업에서의 LLM 성능을 평가하는 영역입니다.

이 순위는 코드 작성·버그 수정 능력, 웹 라이브러리와 프레임워크 이해도, 문서 작성 품질 등을 중심으로 산출되며, 실제 개발 환경에서 얼마나 효율적으로 활용될 수 있는지를 보여줍니다.

2025년 8월 22일 기준 순위 (Chatbot Arena)

- GPT-5 (high) — 점수 1481 (4,012표)

- Claude Opus 4.1 thinking-16k — 점수 1474 (1,604표)

- Claude Opus 4.1 — 점수 1436 (2,011표)

- Gemini-2.5-Pro — 점수 1405 (7,348표)

- DeepSeek-R1 (0528) — 점수 1392 (4,800표)

OpenAI가 출시한 GPT-5는 시간이 지난 현재에도 LMArena 최신 데이터에서 Text와 WebDev 두 카테고리 모두 상위권을 차지하며, 플래그십 모델로서의 입지를 굳히고 있습니다. Text 영역에서는 한때 Gemini-2.5-Pro에 1위를 내주었지만 여전히 견고한 2위를 유지하고 있으며, 이어서 Claude Opus 4.1 Thinking이 뒤를 잇고 있습니다. 반면 WebDev 영역에서는 출시 이후 지금까지 꾸준히 1위를 유지하며, 경쟁 모델들의 순위 변동 속에서도 뚜렷한 존재감을 드러내고 있습니다.

이러한 결과는 GPT-5가 출시 직후부터 전 영역에서 안정적이고 고른 성능 향상을 보여주며, 업계 전반에서 주목받는 대표 모델로 자리매김하고 있음을 잘 보여줍니다.

Artificial Analysis - AI 종합 성능 및 가성비 비교

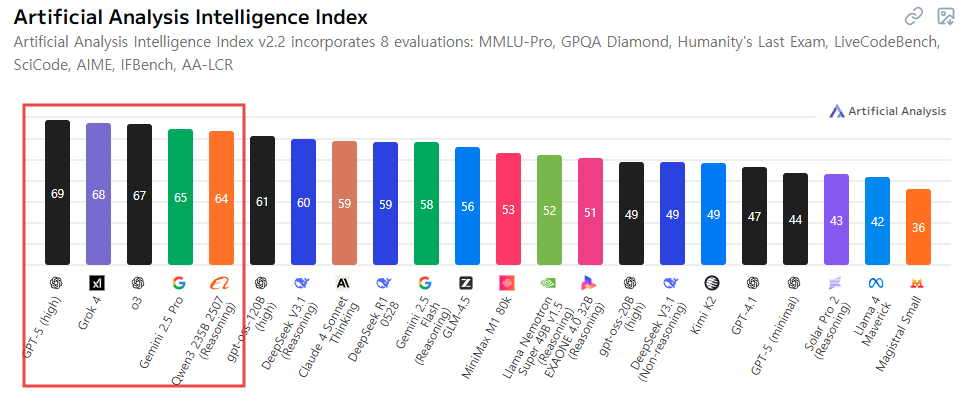

Artificial Analysis는 LLM(대형 언어 모델)의 성능을 다양한 표준 테스트셋을 기반으로 종합 평가합니다. MMLU-Pro, GPQA Diamond, Humanity’s Last Exam, LiveCodeBench, SciCode, AIME, IFBench, AA-LCR 등 총 8가지 항목이 반영되며, 언어 이해력·추론 능력·코딩 및 수학적 사고·멀티모달 이해력 등 다방면의 성능을 점수화합니다.

아래 이미지는 2025년 8월 기준 AI 종합 성능 순위와 성능 대비 가격(가성비) 결과를 보여주며, 단순히 성능이 높은 모델뿐 아니라 비용 효율성까지 함께 파악할 수 있습니다.

[AI 종합 성능 지수 TOP 5]

AI 종합 성능 지수는 다양한 벤치마크 결과를 종합하여 모델의 전반적인 지능 수준을 수치화한 지표입니다. 점수가 높을수록 언어 이해, 논리 추론, 문제 해결, 코드 작성 등 광범위한 영역에서 뛰어난 성능을 발휘함을 의미합니다.

2025년 8월 기준 순위 (Artificial Analysis)

- GPT-5 (high) — 68.95점

- Grok-4 — 67.52점

- o3 — 67.07점

- Gemini 2.5 Pro — 64.63점

- Qwen3 235B — 63.59점

[가성비 우수 모델 TOP 5]

성능 대비 가격 지표(Intelligence vs. Price)는 종합 성능 점수를 100만 토큰당 사용 비용과 비교한 결과입니다. 우측 상단에 위치한 모델일수록 성능과 가격 효율성이 모두 뛰어난 것으로 평가됩니다.

2025년 8월 기준 순위 (Artificial Analysis)

- GPT-OSS-20B (high) — 초저가로 고성능 제공 (100만 토큰당 $0.09)

- GPT-OSS-120B (high) — 대규모 파라미터 기반, 성능·비용 균형 우수 (100만 토큰당 $0.26)

- DeepSeek V3.1 (Reasoning) — 코딩·추론 성능 강점, 저비용 실행 (100만 토큰당 $0.96)

- Gemini-2.5 Flash (Reasoning) — 빠른 응답 속도와 저렴한 가격이 장점 (100만 토큰당 $0.85)

- GPT-5 — 플래그십 모델로서 전반적인 언어 이해력, 추론, 멀티모달 성능에서 최고 수준 (100만 토큰당 $3.44)

- Grok 4 — 창의적 문제 해결과 대화 품질에서 강점을 보이는 모델 (100만 토큰당 $6.00)

2025년 8월 Artificial Analysis 결과에 따르면, 성능 면에서는 GPT-5(high)가 종합 1위를 차지하며 독보적인 성능을 입증했습니다. Grok-4, o3, Gemini-2.5 Pro, Qwen3-235B가 그 뒤를 이었습니다.

가성비 부문에서는 오픈소스 모델이 강세를 보였습니다. GPT-OSS-20B($0.09)와 GPT-OSS-120B($0.26)가 성능과 비용 효율성에서 모두 우수한 결과를 보였고, DeepSeek의 최신 모델, DeepSeek V3.1 (Reasoning)도 코딩·추론 능력과 저렴한 비용으로 주목받았습니다.

상용 모델 중에서는 Gemini-2.5 Flash (Reasoning)이 빠른 응답 속도와 합리적인 가격($0.85)으로 가장 실용적인 선택지로 평가되었습니다.

GPT-5는 출시 이후 다양한 논란과 상반된 평가 속에서도 꾸준히 주목을 받아왔습니다. 그러나 실제 성능 지표와 사용자들의 선택을 종합해 보면, GPT-5는 객관적인 평가와 실사용자 만족도 모두에서 우수한 성과를 보여주었습니다. 이러한 결과는 GPT-5가 플래그십 모델로 자리매김했음을 잘 보여줍니다. 동시에 오픈소스 모델과 경쟁 상용 모델들의 약진도 두드러지고 있어, 이번 비교는 단순히 GPT-5의 성능을 확인하는 것을 넘어, 현재 LLM 시장 전반의 흐름과 각 모델의 위치를 살펴볼 수 있었습니다.

감사합니다. 😊

[오픈소스 활용하기]

- 오픈소스 모델 GPT-OSS 활용하기 : [Marcus' Story] - GPT‑OSS, OpenAI의 오픈소스 AI 모델을 로컬에서 실행해보세요 | Ollama 활용법 | 오픈소스 AI

'AI 소식' 카테고리의 다른 글

| GPT-5 vs Gemini vs Claude|2025년 9월 LLM 성능 순위 & 가성비 추천 모델 정리 (3) | 2025.09.12 |

|---|---|

| 카카오 PlayMCP란 무엇인가|MCP 기반 AI 실험 공간 살펴보기 (2) | 2025.09.05 |

| GPT-5 출시 이후 논란과 대응, GPT-4o·4.1 다시 제공 시작 (2) | 2025.08.18 |

| Anthropic Claude Opus 4.1 출시 | 벤치마크 성능·구독별 접근 권한 총정리 (6) | 2025.08.13 |

| GPT-5 출시로 재편된 2025년 8월 LLM 순위 | 성능·가성비·한국어 특화 모델 완전 비교 (3) | 2025.08.13 |