안녕하세요,

최근 인공지능 분야에서는 다양한 기업들이 자사의 기술력을 기반으로 한 AI 모델들을 활발히 공개하고 있습니다. 특히 오픈소스 생태계의 확장과 함께, 연구·개발자뿐만 아니라 일반 사용자들도 손쉽게 AI 모델을 활용할 수 있는 환경이 마련되고 있습니다.

이번 글에서는 엔비디아가 Qwen2.5 모델을 기반으로 파인튜닝하여 공개한 OpenReasoning-Nemotron 시리즈를 소개하고자 합니다. 이 모델은 고품질 추론 성능과 다양한 파라미터 규모를 제공하며, 연구와 상용 서비스 모두에 적용 가능한 폭넓은 활용성을 지니고 있습니다.

OpenReasoning-Nemotron 모델

OpenReasoning-Nemotron은 NVIDIA가 개발한 일련의 추론(reasoning) 전문 대규모 언어 모델(LLM)로, 수학·코딩·과학 등 복잡한 추론 문제 해결에 뛰어난 성능을 보이는 것이 특징입니다. 이러한 모델들은 다양한 크기(1.5B, 7B, 14B, 32B)로 제공되며, 상업적·비상업적 연구 및 개발에 모두 사용 가능합니다.

- NVIDIA 허깅페이스 : https://huggingface.co/collections/nvidia/openreasoning-nemotron-687730dae0170059860f1f01

[모델 버전별 정보 요약]

| 모델명 | 기반 아키텍처 | 파라미터 | 주요 용도 | 참고 |

| OpenReasoning-Nemotron-1.5B | Qwen2.5-1.5B | 1.5B | 경량, 효율적 추론 연구 | 소규모 하드웨어 지원 |

| OpenReasoning-Nemotron-7B | Qwen2.5-7B-Instruct | 7B | 중규모 추론, 코드·수학 벤치마크 중상위 | 다양한 서비스에 적합 |

| OpenReasoning-Nemotron-14B | Qwen2.5-14B-Instruct | 14B | 대규모 추론, SOTA 성능에 가까움 | 고성능 연구/서비스 |

| OpenReasoning-Nemotron-32B | Qwen2.5-32B-Instruct | 32B | 초대형, SOTA 추론 성능 제공 | 최상위 추론 연구·서비스 |

주요 특징

- Qwen2.5 기반 아키텍처

- Qwen2.5 시리즈(예: Qwen2.5-32B-Instruct)를 기반으로 다양한 파라미터 규모의 변형 모델을 개발

- 지식 증류(Knowledge Distillation) 기술을 적용하여, 대형 모델의 추론 능력과 지식을 소형·중형 모델로 전이

- 적은 연산 자원으로도 높은 수준의 추론 성능 구현

- 대규모 추론·지식 증류 데이터셋

- DeepSeek R1 등 대형 모델을 활용해 수학·코딩·과학 영역의 고품질 추론 데이터 500만 건 이상 생성

- 생성된 데이터셋을 지식 증류 학습에 활용하여 성능 극대화

- 병렬 추론(GenSelect) 기능

- 여러 개의 추론 경로를 동시에 실행 후 최적 해답을 선택

- 수학, 코딩, 과학 문제 등 다양한 영역에서 품질 향상 효과

- 긴 컨텍스트 처리

- 최대 64,000 토큰까지 지원

- 장문·복잡한 문맥의 문제를 효과적으로 처리 가능

벤치마크 성능

OpenReasoning-Nemotron 시리즈는 파라미터 규모가 커질수록 전반적인 성능이 향상되며, 특히 32B 모델은 모든 벤치마크 지표에서 최고 점수를 기록합니다. 소형 모델인 1.5B 모델도 수학과 코드 영역에서 안정적인 성능을 보여 경량 환경에서도 활용 가능성이 높습니다.

[벤치마크 지표]

- ArtificalAnalysisIndex: 종합 인공지능 분석 지수로, 다양한 과제에서의 전반적인 AI 성능을 평가하는 지표

- GPQA: 과학·전문 지식 기반 질의응답 성능 평가(Graduate-Level Physics Question Answering)

- MMLU-PRO: 일반 지식 및 추론 종합 평가(Massive Multitask Language Understanding - PRO 버전)

- HLE: 고난도 논리 추론 문제 해결 능력 평가(High-Level Evaluation)

- LiveCodeBench*: 실시간 코드 작성 및 실행 능력 평가 벤치마크

- SciCode: 과학 문제 해결 및 코드 기반 과학 연산 능력 평가

- AIME24 / AIME25: 수학 경시대회 문제(2024·2025년)에서의 정답률, 복잡한 수학 문제 해결 능력 측정

| 모델 | ArtificalAnalysisIndex | GPQA | MMLU-PRO | HLE | LiveCodeBench | SciCode | AIME24 | AIME25 |

| 1.5B | 31.0 | 31.6 | 47.5 | 5.5 | 28.6 | 2.2 | 55.5 | 45.6 |

| 7B | 54.7 | 61.1 | 71.9 | 8.3 | 63.3 | 16.2 | 84.7 | 78.2 |

| 14B | 60.9 | 71.6 | 77.5 | 10.1 | 67.8 | 23.5 | 87.8 | 82.0 |

| 32B | 64.3 | 73.1 | 80.0 | 11.9 | 70.2 | 28.5 | 89.2 | 84.0 |

라이선스

OpenReasoning-Nemotron 모델은 CC BY 4.0(Creative Commons Attribution 4.0 International) 라이선스를 따릅니다.

이 라이선스는 상업적 사용을 포함한 모든 형태의 이용이 가능하며, 수정·배포·재가공 또한 자유롭게 허용됩니다.

단, 모델 또는 해당 결과물을 사용할 경우 원저작자 표시(Attribution)를 반드시 포함해야 합니다. 표시는 모델명, 출처(URL), 라이선스 명칭 등을 명확하게 기재하는 방식으로 이루어져야 합니다. 따라서, 이 모델은 연구·교육 목적뿐만 아니라, 기업 서비스, 제품 개발, 상용 애플리케이션에도 제약 없이 활용할 수 있습니다.

OpenReasoning-Nemotron 모델 사용 가이드

OpenReasoning-Nemotron 모델은 현재 허깅페이스에서 오픈소스로 제공되고 있습니다. 이번 포스팅에서는 파이썬을 활용해 로컬 환경에서 OpenReasoning-Nemotron-1.5B 모델을 간단하게 실행하는 방법을 소개합니다.

[OpenReasoning-Nemotro 모델 다운로드]

- NVIDIA 허깅페이스 : https://huggingface.co/collections/nvidia/openreasoning-nemotron-687730dae0170059860f1f01

1. 실행 환경

- 운영체제 : Windows 11

- Python : 3.10.11

- accelerate : 1.10.0

- transformers : 4.55.0

- torch : 2.6.0 + cu126

- GPU : NVIDIA GeForce RTX 4060 Ti (VRAM 16 GB)

2. OpenReasoning-Nemotro-1.5B 다운로드

아래 NVIDIA 허깅페이스 페이지에서 OpenReasoning-Nemotron-1.5B 모델을 다운로드합니다. 이 모델은 시리즈 중 가장 작은 버전으로, 온디바이스 환경을 고려해 설계되었습니다. 컴퓨팅 자원이 충분하다면 더 높은 성능의 다른 모델을 선택해도 무방합니다.

3. 패키지 설치

아래 명령어를 통해 해당 모델을 실행하는 데 필요한 패키지를 설치합니다.

# Windows PowerShell

pip install transformers accelerate

pip install torch==2.6.0 --index-url https://download.pytorch.org/whl/cu126

4. 코드 작성

필요한 패키지 설치가 완료되면, 아래와 같이 모델을 실행하기 위한 코드를 작성합니다.

# Python

import transformers

import torch

model_id = "Path/to/OpenReasoning-Nemotron-1.5B" # 로컬 모델 경로 (사용자 환경에 맞게 수정)

pipeline = transformers.pipeline(

"text-generation",

model=model_id,

model_kwargs={"torch_dtype": torch.bfloat16},

device_map="auto",

)

# Code generation prompt

prompt = """You are a helpful and harmless assistant. You should think step-by-step before responding to the instruction below.

Please use python programming language only.

You must use ```python for just the final solution code block with the following format:

```python

# Your code here

```

{user}

"""

messages = [

{

"role": "user",

"content": prompt.format(user="Write a program to calculate the sum of the first $N$ fibonacci numbers")},

]

outputs = pipeline(

messages,

max_new_tokens=1024,

)

print(outputs[0]["generated_text"][-1]['content'])

5. 실행 결과

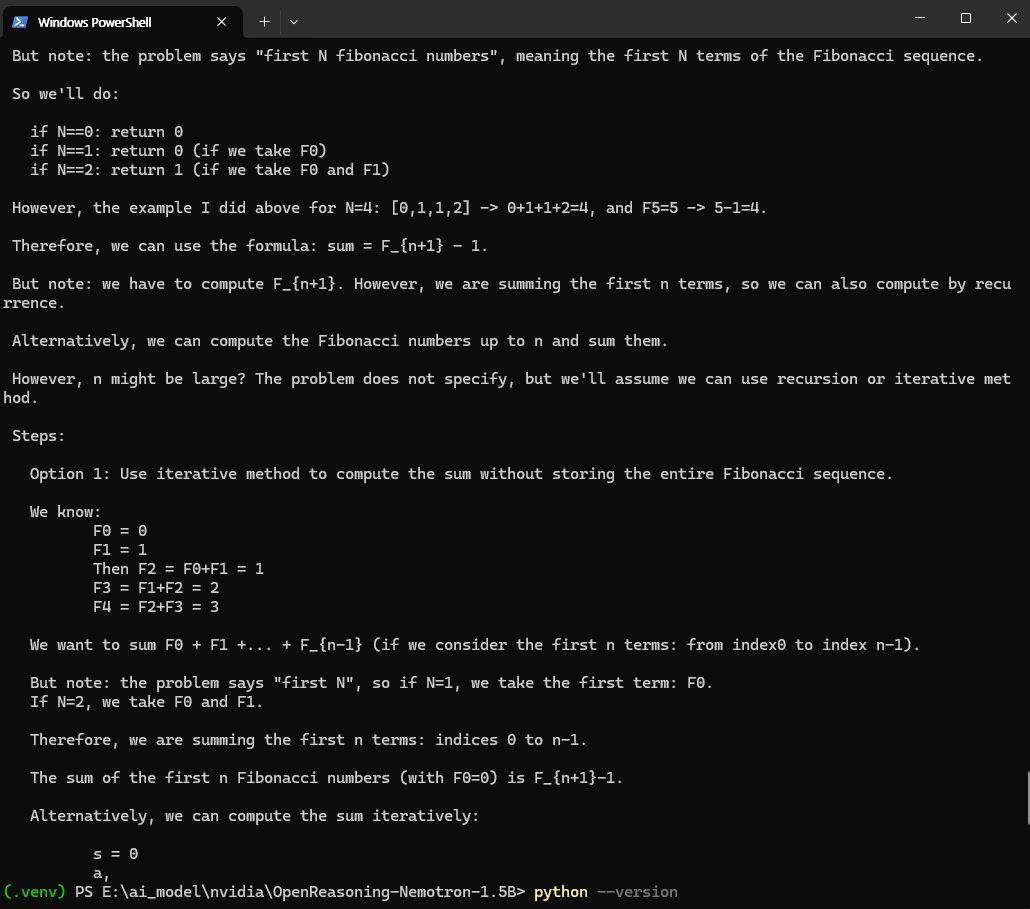

OpenReasoning-Nemotron-1.5B 모델을 실행한 결과, 약 4GB의 VRAM을 사용하여 답변을 생성하였습니다. max_new_tokens는 출력 길이를 설정하는 옵션으로, 값이 클수록 더 긴 답변을 생성합니다. 이 모델은 긴 컨텍스트 처리가 강점이므로, 1.5B 모델에서도 최대 64,000 토큰까지 설정할 수 있습니다. 테스트 결과, max_new_tokens를 256으로 설정했을 때는 약 10초, 512로 설정했을 때는 약 30초, 1024로 설정했을 때는 약 50초가 소요되었습니다.

아래는 실제 테스트에 사용한 입력값과 결과입니다.

- 사용 프롬프트 : "Write a program to calculate the sum of the first $N$ fibonacci numbers" (처음 N개의 피보나치 수의 합을 계산하는 프로그램을 작성하라)

- 출력 토큰 크기(max_new_tokens 값) : 1024

이번 테스트 결과는 약 50초가 소요되어 출력되었습니다. OpenReasoning-Nemotron-1.5B는 수학 분야에 강점을 가진 모델이어서, 입력한 프롬프트에 맞춰 단계적으로 답을 찾기 위해 코드를 생성했습니다. 그러나 출력 토큰 크기가 부족해 최종 결과가 중간에 잘리는 현상이 발생했습니다. 1.5B 모델은 비교적 작은 규모이기 때문에 복잡하고 정밀한 문제 해결에서는 한계가 있는 것으로 보였였습니다. 이러한 특성상, 1.5B 모델은 고난도 연산보다는 온디바이스 환경에서 간단한 질의응답이나 가벼운 코드 생성 등 경량 작업에 활용하는 것이 더욱 효율적으로 보입니다.

OpenReasoning-Nemotron 시리즈는 NVIDIA가 오픈소스로 배포한 고성능 추론 특화 AI 모델로, 경량형부터 초대형까지 다양한 버전을 제공하여 환경과 목적에 맞춰 선택할 수 있습니다. 이번 글에서는 그중 가장 작은 1.5B 모델을 예시로, 로컬 환경에서 직접 실행하는 방법과 성능을 살펴보았습니다.

1.5B 모델은 낮은 VRAM 요구량과 빠른 응답 속도로, 제한된 하드웨어 환경에서도 부담 없이 실행할 수 있다는 장점이 있습니다. 처음 로컬 AI 모델을 사용해보고자 한다면, 이와 같은 경량 모델로 시작해 환경을 구성한 뒤, 필요에 따라 더 큰 모델로 확장하는 접근이 효율적입니다.

NVIDIA의 허깅페이스 페이지에서 모델을 내려받아, 직접 실행해보며 로컬 AI의 가능성을 체험해 보시기 바랍니다. 작은 시작이지만, 이를 통해 로컬 AI 활용의 첫걸음을 내딛을 수 있습니다.

감사합니다. 😊

'AI 소식 > 오픈소스 AI 모델' 카테고리의 다른 글

| [오픈소스 AI] 중국 MetaStone AI의 XBai-o4 공개 – 성능, 특징, 벤치마크 완전 분석 (4) | 2025.08.15 |

|---|---|

| 중국 텐센트 LLM ‘Hunyuan-A13B-Instruct’ 소개 | 오픈소스 AI | (6) | 2025.08.14 |

| GPT‑OSS, OpenAI의 오픈소스 AI 모델을 로컬에서 실행해보세요 | Ollama 활용법 | 오픈소스 AI (6) | 2025.08.07 |

| 이미지 인식 AI ‘FastVLM’ 출시|애플의 비전-언어 모델 테스트 결과 정리 (3) | 2025.08.05 |

| [오픈소스 AI] 중국 Z.ai의 초강력 오픈소스 LLM, 'GLM-4.5'를 소개합니다. (2) | 2025.08.04 |